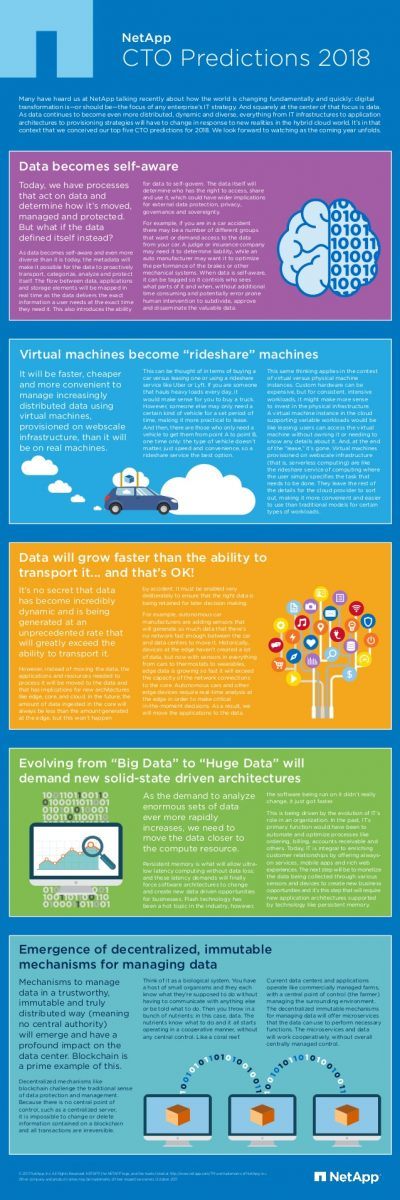

In dem Maße, wie sich Daten im Zuge der digitalen Transformation immer mehr ausbreiten sowie noch dynamischer wachsen und vielfältiger werden, muss sich auch die gesamte IT-Infrastruktur verändern. Es gilt, ausgehend von der Applikations-Architektur bis zur Bereitstellungsstrategie und einschließlich der Datenverwaltung alles an die Geschäftsrealität in der Hybrid-Cloud anzupassen. In dieser führt ein intelligenterer Umgang mit den Daten über fünf Wege, auf denen Unternehmen bereits im Jahr 2018 vorausfahren können – und sollten.

In dem Maße, wie sich Daten im Zuge der digitalen Transformation immer mehr ausbreiten sowie noch dynamischer wachsen und vielfältiger werden, muss sich auch die gesamte IT-Infrastruktur verändern. Es gilt, ausgehend von der Applikations-Architektur bis zur Bereitstellungsstrategie und einschließlich der Datenverwaltung alles an die Geschäftsrealität in der Hybrid-Cloud anzupassen. In dieser führt ein intelligenterer Umgang mit den Daten über fünf Wege, auf denen Unternehmen bereits im Jahr 2018 vorausfahren können – und sollten.

1. „Selbstbewusste“ Daten sind schneller beim Nutzer

Heute bestimmen Prozesse, wie Daten behandelt, bewegt, gemanagt und geschützt werden. Das Gegenteil wäre, wenn Daten das alles selbst aus sich heraus festlegen würden. Die Daten wären sozusagen selbstbewusst und selbstbestimmt, wodurch ihre Vielfältigkeit zunähme. Reine Utopie? Nein, denn Metadaten ermöglichen es, dass sich Daten proaktiv um Transport, Kategorisierung, Analyse und Schutz kümmern. Der Informationsfluss zwischen Daten, Applikationen und Speicher wird in Echtzeit abgebildet. Das befähigt dazu, exakt den Informationsbedarf zu dem Zeitpunkt zu bedienen, wenn dieser beim Nutzer entsteht. Daten können sich so selbst verwalten, da sie bestimmen, wer auf sie zugreifen, sie teilen oder nutzen darf. Daraus ergeben sich Konsequenzen für externe Daten in puncto Sicherheit, Schutz, Kontrolle und Hoheit.

Die Praxisrelevanz lässt sich am Beispiel eines Autounfalls schildern. Eine Anwaltskanzlei oder Versicherung benötigt den Zugriff auf die Autodaten, um die Haftungsfrage zu klären. Oder ein Autohersteller will die Daten für das Verbessern der Bremsen oder anderer mechanischer Systeme nutzen. Bei „selbstbewussten“ Daten wäre die Kontrolle gegeben, wer was sieht. Das würde ohne zusätzlichen Zeitaufwand geschehen. Außerdem entfiele so der fehleranfällige menschliche Eingriff.

2. Virtuelle-Maschinen als „Mitfahrgelegenheit“

Eigene Hardware kann eine teure, aber sinnvolle Investition sein, um einen anspruchsvollen Workload wie SAP-HANA konsistent abzubilden. Eine virtuelle Maschine (VM) in der Cloud unterstützt hingegen unterschiedliche Anwendungen, die an das Leasing-Prinzip erinnern: Nutzer erhalten Zugang zur VM, ohne diese zu besitzen und im Detail kennen zu müssen. VMs lassen sich auch von einer Web-Scale-Infrastruktur bereitstellten, deren physische Komponenten wie Server, Speicher und Rechenleistung virtualisiert sind.

Eigene Hardware kann eine teure, aber sinnvolle Investition sein, um einen anspruchsvollen Workload wie SAP-HANA konsistent abzubilden. Eine virtuelle Maschine (VM) in der Cloud unterstützt hingegen unterschiedliche Anwendungen, die an das Leasing-Prinzip erinnern: Nutzer erhalten Zugang zur VM, ohne diese zu besitzen und im Detail kennen zu müssen. VMs lassen sich auch von einer Web-Scale-Infrastruktur bereitstellten, deren physische Komponenten wie Server, Speicher und Rechenleistung virtualisiert sind.

In so einer Umgebung funktionieren VMs wie das „Mitfahren“ bei einem serverlosen Computing. Der Nutzer spezifiziert seinen Auftrag, um die Details kümmert sich der Cloud-Provider, damit die Nutzung angenehmer und einfacher wird. Im übertragen Sinn will der Nutzer eine Strecke von A nach B schnell und bequem zurückgelegen, wobei der Fahrzeugtyp keine Rolle spielt. Für ihn stellt eine Mitfahrgelegenheit die beste Option dar. In der IT-Welt lassen sich die immer stärker verteilten Daten schneller, kostengünstiger und bequemer mit VMs in einer Web-Scale-Infrastruktur verwalten.

3. Datenmengen wachsen schneller als deren Übertragungsmöglichkeit

Daten werden künftig in einer unvorstellbaren Rate erzeugt, die bei weitem die Fähigkeit überschreitet, sie zu transportieren. Für die Zukunft bedeutet das: Die Datenmenge im Core, im Rechenzentrum, wird immer geringer sein als diejenige, die Edge-Computing generiert. Unter Edge versteht man das Computing am äußeren Rand eines Netzwerkes – beispielsweise eine Anwendung für das Internet of Things (IoT).

Bisher haben Geräte im Edge keine riesige Datenmenge produziert. Durch die Sensoren in all den Dingen, vom Auto über Thermostate bis zu den tragbaren Geräten wie Smart-Watches, beschleunigt sich das Datenwachstum, welches die Kapazität einer Netzwerkverbindung ins Rechenzentrum schlicht überfordert. Autonome Autos und andere Geräte im Edge benötigen Echtzeitanalysen, um sofort geschäftskritische Entscheidungen fällen zu können. Daraus ergeben sich zwei Notwendigkeiten: das Verlagern der Applikationen und Ressourcen für die Verarbeitung zu den Daten. Die Datenerzeugung im Edge geschieht nicht zufällig, sondern die IT muss gewährleisten, dort die richtigen Daten zu erheben und zu verarbeiten.

4. Aus „Big Data“ wird „Huge Data“ auf hochverfügbaren Speichern

Der Bedarf steigt, riesige Datenmengen zu analysieren – befeuert dadurch, dass sich maschinelles Lernen und künstliche Intelligenz verbreiten. Infolgedessen müssen die Daten enger an die Rechenressourcen rücken. Hochverfügbare Speicher gestatten, Rechenoperationen bei ultraniedriger Latenz durchzuführen, ohne dass Daten verloren gehen. Dieses Latenzkriterium verlangt nach anderen Architekturen für die Software als bisher, um neue datengetriebene Geschäftsmodelle zu entwickeln. Deswegen ist die Flash-Technologie in der Industrie ein heißes Thema. Die Software, die auf den superschnellen Flash-Speichern läuft, hat sich jedoch noch nicht wirklich verändert.

Heute ist die IT integral dafür zuständig, die Kundenbeziehung aufzuwerten. Dazu offeriert sie ständig Dienste, mobile Apps und reichlich Web-Erlebnisse. Der nächste Schritt besteht darin, die Daten, die Sensoren und Geräte sammeln, zu monetarisieren. Das geht nur über eine Applikations-Architektur, die sich auf hochverfügbare Speicher stützt.

5. Dezentrales und unveränderbares Datenmanagement

Mechanismen, die Daten vertrauenswürdig managen, dabei nicht verändern und wirklich verteilen, werden sich etablieren. Blockchain, bei der Datenblöcke über kryptographische Verfahren miteinander verkettet sind, bilden das wichtigste Beispiel für diese Entwicklung. Blockchain stellt den traditionellen Sinn von Datensicherheit und -management infrage. Denn es gibt keine zentrale Kontrollinstanz wie einen Zentralserver. Es ist unmöglich, Informationen in einer Blockchain zu verändern oder zu löschen.

Heutige Rechenzentren und Applikationen operieren jedoch wie eine konventionelle Farm in den USA. Der Farmer ist dort die zentrale Kontrollinstanz, um die Umgebung zu verwalten. Ein dezentralisierter und unveränderbarer Mechanismus für das Datenmanagement wird hingegen Microservices bieten. Mit diesen lassen sich Daten nutzen, um nötige Funktionen im Rechenzentrum zu performen. Microservices und Daten arbeiten dann zusammen, eine zentralisierte Verwaltungskontrolle hat in dem Szenario keine Daseinsberechtigung mehr.

Von Mark Bregman, CTO bei NetApp

#Netzpalaver #NetApp